离机器人杀人还有5-10年,马斯克说了,霍金附议,你怎么看 2014-11-18 英鹏硬创

今天在网络上大量传播Tesla和SpaceX创始人埃隆·马斯克(Elon Musk)日前在Edge.org发表的“机器人杀人”论,马斯克说人工智能(AI)的发展将使机器人在不远的将来能够自主决定屠杀人类,这将在5年,最多10年内发生。

但是这篇评论很快就被删除了,不过没关系,硬邦邦有马斯克在Edge.com发表的原文截图:

原文如下,硬邦邦做了翻译:

"The pace of progress in artificial intelligence (I'm not referring to narrow AI) is incredibly fast. Unless you have direct exposure to groups like Deepmind, you have no idea how fast-it is growing at a pace close to exponential. The risk of something seriously dangerous happening is in the five year timeframe. 10 years at most.Please note that am normally super pro technology ,and have never raised this issue until recent months . This is not a case of crying wolf about something I don't understand.

I am not alone in thinking we should be worried. The leading AI companies have taken great steps to ensure safety. The recognize the danger, but believe that they can shape and control the digital superintelligences and prevent bad ones from escaping into the Internet. That remains to be seen..." - Elon Musk

“人工智能的发展让人难以置信,除非你非常了解Deepmind这样的公司,否则你根本无法想象其发展速度,当然,这里的人工智能不是狭义而是广义上的。人工智能的极速发展会对人类产生严重的威胁,这种威胁将在5年,最多10年内发生。虽然我们直到最近才意识到这种威胁,但是务必要警惕:请相信我不是一个一无所知的孩子在喊‘狼来了’。

幸而我不是唯一一个意识到这种威胁的人,前沿的人工智能公司也在采取措施确保人类的安全。意识到危险,但是相信人类有能力控制这种数字化的超智能、并且预防互联网的不良衍生,大概是我们现在应该持有的态度。一切,仍在观察之中。”

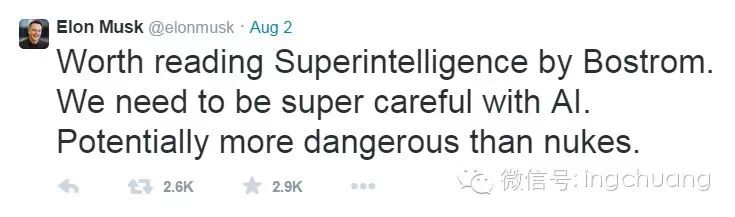

Elon Musk不是第一次提出人工智能威胁人类的警告,在今年8月初,马斯克就在Twitter上发了这样一条消息:

马斯克那时就称人工智能的潜在威胁要大于核武器,但他的言论也遭到了不少网友的炮轰,幸而马斯克并不孤独,大物理学家史蒂芬·霍金(

Stephen William Hawking)也同样担忧人工智能对人类的威胁。

2014年4月,霍金在讨论约翰尼德普(Johnny Depp)主演的新片《超验骇客》时就称,人工智能或许不但是人类历史上最大的事件,而且还有可能是最后的事件,他老人家认为:人工智能可能会使人类灭亡。

霍金仍怕不能引起人们的重视,于是又在英国《独立》杂志(The Independent)撰文明确表示了他的担忧:“人工智能的短期影响取决于由谁来控制它,而长期影响则取决于它是否能够被控制。”不管从短期还是长期来讲,人工智能都存在巨大的风险。

霍金不仅担心未来的人工智能技术,甚至包括现在的一些公司,比如谷歌和Facebook(幸好没有担心马斯克的公司特斯拉和SpaceX)。霍金似乎根本就不信任所谓的人工智能专家,“人类在考核人工智能技术的潜在风险和收益方面所做的研究工作太少”。

人工智能的专家们,当然是不认可霍金和马斯克的观点,有人反驳说:

事实上,我们现在最聪明的人工智能产品也仅仅是与一个刚会走路的孩子智力相当,而这还仅限于处理一些需要外部帮助的任务(如信息召回)。大多数机器学家仍然在努力使机器人们能够捡起一个球,跑步时不会摔倒,这看起来离“天网”的最终结局还有十万八千里。

然而,霍金和马斯克的支持者认为:

实际上,对于公众而言,Musk与霍金口中的人工智能才是真正的“人工智能”—— 由人类所创造的类人的智能,而科学家的定义——人工智能就是研究如何使计算机去做过去只有人才能做的智能工作——则往往显得过于专门而狭隘。

目前的人工智能的确还算不上是人类的威胁,但随着技术的进步,一旦人类突破了某个关键的技术节点,人工智能将会以一种不可阻挡的趋势降临人间。

硬邦邦不知道霍金和马斯克的担忧会不会很快发生,但如果你要问假如霍金和马斯克的担忧是真的,那我天朝还要不要发展人工智能和机器人?答案是肯定的:和我们造原子弹的道理一样。